L’intelligence artificielle pour chasser le « bruit » des images des satellites radar (IP Paris)

mercredi 5 février 2025

Florence Tupin

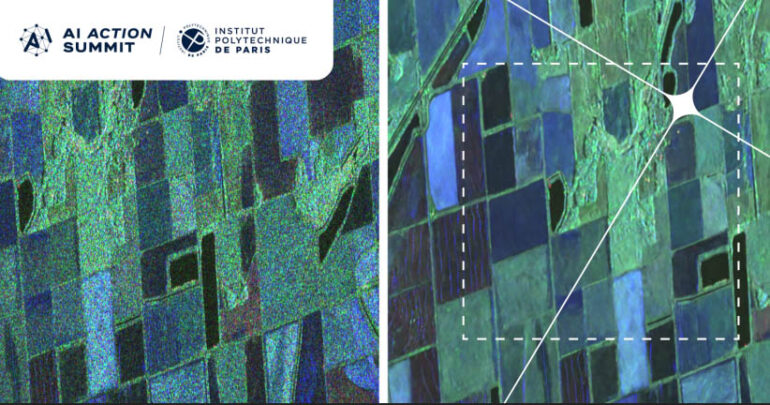

« Les images obtenues sont souvent pleines de fluctuations qui se traduisent par des « couleurs » altérées et une forme de granularité qui les rend difficiles à interpréter », explique Florence Tupin, professeure au Laboratoire Traitement et Communication de l’Information (LTCI) de Télécom Paris. La chercheuse, qui s’est fait une spécialité de « débruiter » ces images avec l’aide de l’intelligence artificielle (IA), ou plus précisément de l’apprentissage statistique, a développé des méthodes innovantes permettant « de les améliorer drastiquement ».

En traitement d’images, les réseaux de neurones artificiels – un système adaptatif d’IA qui apprend aux algorithmes à traiter des données à partir d’un grand nombre d’exemples – sont généralement entraînés à obtenir une image sans « bruit » en leur montrant le type d’images à obtenir à partir de l’image « bruitée » acquise. L’approche d’apprentissage profond (Deep Learning) de Florence Tupin et ses collègues permet au contraire de travailler sans image de « vérité terrain ». « En résumé, on fournit au réseau deux versions bruitées de la même scène, donc des images qui présentent la même information mais avec des bruits différents », explique la chercheuse. « C’est la partie identique aux deux images, c’est-à-dire la scène sans bruit, que le réseau sera capable de prédire. »